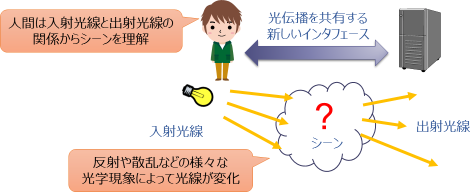

本研究室のミッション

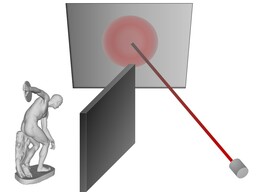

光源から出た光は,シーン中で反射・屈折・散乱等の光学現象を繰り返し,

カメラや我々の眼に届きます.

我々人間は眼で見ただけで,

物体表面の状態がツルツルしているのかザラザラしているのかといった表面の荒さだけではなく,

重いのか軽いのかといった質量や,

金属なのかプラスチックなのかといった材質に関する物理情報,

さらには安っぽいのか高級感があるのかといった感性に関わる情報も感じ取っています.

つまり,光線はシーンに関する貴重な情報を運ぶ媒体と考えることができます.

この光の伝播からシーンを理解する能力をコンピュータ上で実現することで,

光を媒体として人間とコンピュータがシーンの情報を共有できる

「光メディアインタフェース」を実現することを目指しています.

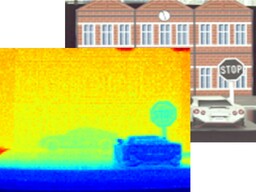

コンピュータビジョン

カメラで撮影された視覚情報に基づいて,物体の3次元形状や材質を推定し, コンピュータがシーンを理解する技術を開発します. そのためには,通常のカメラだけではなく,遠赤外カメラや分光カメラ, さらには物体までの距離を計測する Time-of-Flightカメラなど, 様々なカメラで得られた光学情報を物理モデルや深層学習によって解析します. 車の自動運転や製品検査など,産業界でも必要とされている技術です.

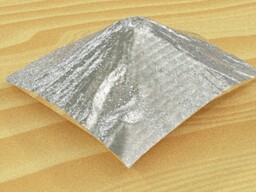

コンピュータグラフィクス

光の反射や散乱を忠実に再現することで,実物が持つ独特の質感を描き, 実物と見分けのつかない写実的なCGをレンダリングする技術を開発します. 単にCGをディスプレイに表示するだけではなく, 実物そっくりのレプリカを作成したり,立体視やプロジェクションマッピングなど, 視覚情報の新しい見せ方の開発にも挑戦しています.

コンピュテーショナルフォトグラフィ

カメラによる写真撮影の過程に計算処理を組み込むことで, カメラの機能を大幅に進化させます. 単なる画像処理ではなく, 光学系の工夫を加えることでカメラの物理的な性能限界をも超えることができ, 通常のカメラでは不可能な撮影が可能となります. 最近ではスマートフォンにも実装されている新しい技術です.

センシングシステム開発

シーン中を飛び交う光線が持つ,通過位置や角度, 飛行時間や波長などを計測するために, 目的に合わせた専用のセンシングシステムを設計開発します. レンズや反射鏡などの様々な光学素子や光源を組み合わせることで, 世界に1台しかないシステムを構築します.